Introducción

En la actualidad no nos podemos imaginar casi ninguna actividad en la cual no intervengan de alguna manera los procesos de cómputo. Las computadoras han invadido la mayoría de las labores del ser humano; hoy día todos los habitantes del mundo somos dependientes directos o indirectos del uso de las computadoras, como en oficinas bancarias, centros de enseñanza, oficinas de ventas, clínicas médicas u hospitales, fabricas y almacenes industriales, organismos de gobierno y oficinas administrativas, laboratorios, entre muchos otros.

La revolución producida por la computadora en el saber humano proviene de la concentración de conocimientos que puede memorizar, la elaboración que de ellos pueden hacer, y de la complejidad de los estudios y tareas que puede realizar mediante instrucciones programadas.

Haciendo un esbozo historiográfico, durante la segunda guerra mundial, se desarrollo una imponente maquina calculadora en la universidad de Pennsylvania, bautizada con el nombre de ENIAC (Electronic Numerical Integrator and Calculator), pesaba 30 toneladas y ocupaba una superficie de más de 200 m2. Su existencia se debió a la necesidad de calcular las tablas de disparos de los proyectiles que implicaban una enorme cantidad de operaciones aritméticas. La evolución de las computadoras se tiende a dividir en generaciones, teniendo en cuenta adelantos y desarrollos tecnológicos que las hacen más eficaces, en cuanto a su velocidad y cantidad de operaciones a realizar, más cómoda por su tamaño y sencillez en su utilización y más inteligentes, con relación a las tareas que puedan llegar a cumplir

Estas máquinas maravillosas inventadas por el hombre, tal como ahora las concebimos, son el resultado de una gran secuencia de eventos.

Primera generación (1951 - 1958)

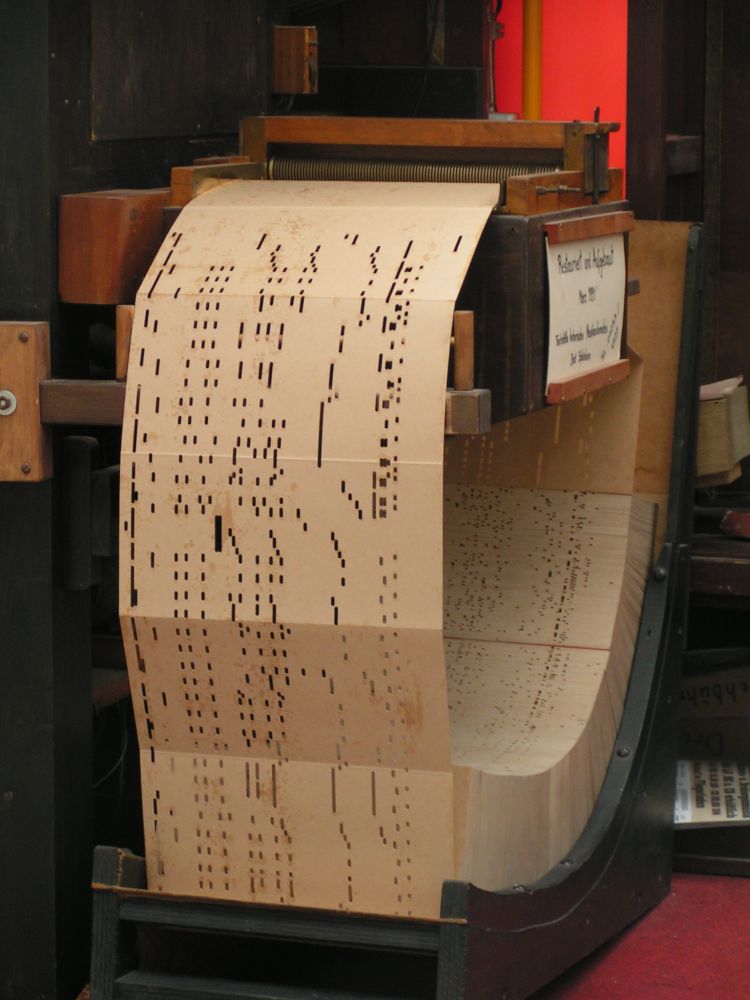

Las computadoras de la primera Generación emplearon bulbos para procesar información. Los operadores ingresaban los datos y programas en código especial por medio de tarjetas perforadas. El almacenamiento interno se lograba con un tambor que giraba rápidamente, sobre el cual un dispositivo de lectura/escritura colocaba marcas magnéticas. Estas computadoras estaban constituidas por tubos de vacío, desprendían bastante calor y tenían una vida relativamente corta, eran grandes y pesadas. Generaban un alto consumo de energía, el voltaje de los tubos era de 300 V y la posibilidad de fundirse era grande

Eckert y Mauchly contribuyeron al desarrollo de computadoras de la primera generación formando una compañía privada y construyendo UNIVAC I, la cual se utilizó para evaluar el censo de 1950. La IBM tenía el monopolio de los equipos de procesamiento de datos a base de tarjetas perforadas, sin embargo no había logrado el contrato para el Censo de 1950.

Comenzó entonces a construir computadoras electrónicas y su primera entrada fue con la IBM 701 en 1953. Después de un lento pero excitante comienzo la IBM 701 se convirtió en un producto comercialmente viable. Sin embargo en 1954 fue introducido el modelo IBM 650, el cual es la razón por la que IBM disfruta hoy de una gran parte del mercado de las computadoras. La administración de la IBM asumió un gran riesgo y estimó una venta de 50 computadoras. Este número era mayor que la cantidad de computadoras instaladas en esa época en EE.UU. De hecho la IBM instaló 1000 computadoras. Aunque caras y de uso limitado las computadoras fueron aceptadas rápidamente por las Compañías Privadas y de Gobierno. A la mitad de los años 50 IBM y Remington Rand se consolidaban como líderes en la fabricación de computadoras.

Segunda generación (1959 - 1964)

El invento del transistor (dispositivo electrónico que sirve como amplificador de señal) hizo posible una nueva generación de computadoras, más rápidas, más pequeñas y con menores necesidades de ventilación. No obstante el costo seguía siendo una porción significativa del presupuesto de una Compañía. Las computadoras de la segunda generación también utilizaban redes de núcleos magnéticos en lugar de tambores giratorios para el almacenamiento primario. Estos núcleos contenían pequeños anillos de material magnético, enlazados entre sí, en los cuales podían almacenarse datos e instrucciones.

Mejoraron los dispositivos de entrada y salida, para la mejor lectura de tarjetas perforadas, se disponía de células fotoeléctricas. Los programas de computadoras también avanzaron. El COBOL (COmmon Busines Oriented Languaje) desarrollado durante la primera generación estaba ya disponible comercialmente; fue uno de los primeros programas que se pudieron ejecutar en diversos equipos de computo después de un sencillo procesamiento de compilación. Los programas escritos para una computadora podían transferirse a otra con un mínimo esfuerzo. Grace Murria Hooper, quien en 1952 había inventado el primer compilador fue una de las principales figuras de CODASYL (Comité on Data SYstems Languages), la misma se encargo de desarrollar el proyecto COBOL, el escribir un programa ya no requería entender plenamente el hardware de la computación.

Las computadoras de la segunda generación eran más pequeñas y rápidas que las de bulbos, y se usaban para nuevas aplicaciones, como en los sistemas para reservación en líneas aéreas, control de tráfico aéreo y simulaciones para uso general. Las empresas comenzaron a aplicar las computadoras a tareas de almacenamiento de registros, como manejo de inventarios, nómina y contabilidad.

La marina de EE.UU. utilizó las computadoras de la segunda generación para crear el primer simulador de vuelo. Para ese entonces HoneyWell se había colocado como el primer competidor durante la segunda generación de computadoras. Algunas de las computadoras que se construyeron ya con transistores fueron la IBM 1401, las Honeywell 800 y su serie 5000, UNIVAC M460, Control Data Corporation con su conocido modeloCDC16O4, y muchas otras, que constituían un mercado de gran competencia, en rápido crecimiento.

Tercera generación (1964 - 1971)

Las computadoras de la tercera generación emergieron con el desarrollo de los circuitos integrados, en las cuales se colocan miles de componentes electrónicos, en una integración en miniatura. Las computadoras nuevamente se hicieron más pequeñas, más rápidas, desprendían menos calor y eran energéticamente más eficientes. El descubrimiento en 1958 del primer Circuito Integrado (chip) por el ingeniero Jack S. Kilbry de Texas Instruments, así como los trabajos que realizaba, por su parte, el Dr. Robert Noyce de Fairchild Semiconductors, acerca de los circuitos integrados, dieron origen a la tercera generación de computadoras. Antes de la llegada de los circuitos integrados, las computadoras estaban diseñadas para aplicaciones matemáticas o de negocios, pero no para las dos cosas.

Los circuitos integrados permitieron a los fabricantes de computadoras incrementar la flexibilidad de los programas, y estandarizar sus modelos. Se instalan terminales remotas, que puedan acceder a la computadora central para realizar operaciones, extraer o introducir información en Bancos de Datos, etc. Aumenta la capacidad de almacenamiento y se reduce el tiempo de respuesta. Se generalizan los lenguajes de programación de alto nivel.

IBM marca el inicio de esta generación, cuando el 7 de abril de 1964 presenta la impresionante IBM 360, con su tecnología SLT (Solid Logic Technology), fue una de las primeras computadoras comerciales que usó circuitos integrados, podía realizar tanto análisis numéricos como administración ó procesamiento de archivos. Esta máquina causó tal impacto en el mundo de la computación que se fabricaron más de 30000.

Se empiezan a utilizar los medios magnéticos de almacenamiento, como cintas magnéticas de 9 canales, enormes discos rígidos, etc. Algunos sistemas todavía usan las tarjetas perforadas para la entrada de datos, pero los lectores de tarjetas ya alcanzan velocidades respetables.

Las computadoras trabajaban a tal velocidad que proporcionaban la capacidad de correr más de un programa de manera simultánea (multiprogramación). Por ejemplo la computadora podía estar calculando la nomina y aceptando pedidos al mismo tiempo. Con la introducción del modelo 360, IBM acaparó el 70% del mercado, para evitar competir directamente con IBM la empresa Digital Equipment Corporation redirigió sus esfuerzos hacia computadoras pequeñas. Mucho menos costosas de comprar y de operar que las computadoras grandes, las minicomputadoras se desarrollaron durante la segunda generación pero alcanzaron un gran auge entre 1960 y 1970.

Cuarta generación (1971 - 1982)

Dos mejoras en la tecnología de las computadoras marcan el inicio de la cuarta generación: el reemplazo de las memorias con núcleos magnéticos, por las de chips de silicio y la colocación de muchos más componentes en un chip, producto de la microminiaturización de los circuitos electrónicos. El tamaño reducido del microprocesador y de chips hizo posible la creación de las computadoras personales.

En 1971, Intel Corporation, que era una pequeña compañía fabricante de semiconductores ubicada en Silicon Valley, presenta el primer microprocesador o chip de 4 bits, que en un espacio de aproximadamente 4 X 5 mm contenía 2250 transistores. Este primer microprocesador fue bautizado como el 4004.

Esta generación de computadoras se caracterizó por grandes avances tecnológicos realizados en un tiempo muy corto. En 1977 aparecen las primeras microcomputadoras, entre las cuales, las más famosas fueron las fabricadas por Apple Computer, Radio Shack y Commodore Busíness Machines. IBM se integra al mercado de las microcomputadoras con su Personal Computer, asimismo se incluye un sistema operativo estandarizado, el MS-DOS (MicroSoft Disk Operating System).

Las principales tecnologías que dominan este mercado son: IBM y sus compatibles llamadas clones, fabricadas por infinidad de compañías con base en los procesadores 8088, 8086, 80286, 80386, 80486, 80586 o Pentium, Pentium II, Pentium III y Celeron de Intel y en segundo término Apple Computer, con sus Macintosh y las Power Macintosh, que tienen gran capacidad de generación de gráficos y sonidos gracias a sus poderosos procesadores Motorola serie 68000 y PowerPC, respectivamente. Este último microprocesador ha sido fabricado utilizando la tecnología RISC (Reduced Instruction Set Computing), por Apple Computer Inc., Motorola Inc. e IBM Corporation, conjuntamente.

Los sistemas operativos han alcanzado un notable desarrollo, sobre todo por la posibilidad de generar gráficos a grandes velocidades, lo cual permite utilizar las interfaces gráficas de usuario (Graphic User Interface, GUI), que son pantallas con ventanas, iconos (figuras) y menús desplegables que facilitan las tareas de comunicación entre el usuario y la computadora, tales como la selección de comandos del sistema operativo para realizar operaciones de copiado o formato con una simple pulsación de cualquier botón del ratón sobre uno de los iconos o menús.

Quinta generación (1982 - actualidad)

La quinta generación inicia a principios de los años ochenta, teniendo como característica principal la evolución de las comunicaciones a la par de la tecnología.

La computación paralela sigue avanzando al grado de que los sistemas paralelos empiezan a competir con los sistemas vectoriales en términos de poder total de cómputo.

La miniaturización de componentes y su consecuente reducción en costo y necesidades técnicas ayudan a obtener sistemas de muy alta capacidad en donde las estaciones de trabajo compiten y superan en capacidad a las supercomputadoras de las generaciones anteriores.

Dentro de los eventos que forjaron el inicio de este período están:

La actualización de la especificación IEEE 802.3, para incluir cableado de par de cobre trenzado con 10 Base T.

Tim Berners-Lee trabaja en una interfaz gráfica de usuario navegador y editor de hipertexto utilizando el ambiente de desarrollo de NeXTStep, bautizando "World Wide Web" al programa y al proyecto.

Motorola presenta el concepto del Sistema Iridium para comunicación personal global, complementando los sistemas de comunicación alámbrica e inalámbrica terrestre.

Formalmente se cierra ARPAnet, que es reemplazada por la NSFnet y las redes interconectadas, dando origen a la participación pública en el desarrollo de lo que se convertiría en la red de redes, Internet, y la formación del grupo de trabajo para redes inalámbricas IEEE802.11 (Wireless LAN Working Group IEEE 802.11).

La implementación de redes de datos digitales se vuelve un asunto cotidiano, no solo alcanzando altas velocidades, sino además creando esquemas jerárquicos de transmisión de datos permitiendo la integración de servicios de video de alta calidad con movimiento total, voz y otros datos digitales multimedia en tiempo real.

El siguiente paso tecnológico consistió en la integración de computadoras en red para trabajo simultáneo o computación distribuida, en donde un proceso en una computadora en red puede encontrar tiempo de procesador en otra de la misma red para realizar trabajos en paralelo.

Otros avances fundamentados en las tecnologías de comunicación son:

Funcionamiento de computadoras en modo agrupado, también conocido como "cluster", en donde varias computadoras se comportan como una misma, dando un grado tal de tolerancia a fallas, que inclusive puede fallar una computadora sin que la funcionalidad se afecte.

Dispositivos inteligentes, yendo desde tostadoras y hornos de microondas, hasta casas y edificios conectados en red para su administración, supervisión y control remoto a través de las redes.

Internet hace entrada en el mundo doméstico abriendo nuevas alternativas para negocios, comercios y empresas creando lo que se conocería como el "bum del punto com", en donde aparecen y desaparecen servidores de Internet en un grado vertiginoso, todos ellos de empresas que buscan un posicionamiento global.

Con las computadoras de nivel elemental de esta época y la caída en los costos de las comunicaciones se llegan a crear negocios virtuales cuya única sucursal puede estar en un servidor doméstico y tener presencia mundial.

Uno de los pronósticos que se han venido realizando sin interrupciones en el transcurso de esta generación, es la conectividad entre computadoras, que a partir de 1994, con la llegada de la red Internet y del World Wide Web, ha adquirido una importancia vital en las grandes, medianas y pequeñas empresas y, entre los usuarios particulares de computadoras.

Sexta generación (futuro)

Como supuestamente la sexta generación de computadoras está por venir, en un futuro no muy lejano, debemos por lo menos, esbozar las características que deben tener las computadoras de esta generación. Las computadoras de esta generación cuentan con arquitecturas combinadas Paralelo/Vectorial, con cientos de microprocesadores vectoriales trabajando al mismo tiempo; se han creado computadoras capaces de realizar más de un millón de millones de operaciones aritméticas de punto flotante por segundo (teraflops); las redes de área mundial (Wide Area Network, WAN) seguirán creciendo desorbitadamente utilizando medios de comunicación a través de fibras ópticas y satélites, con anchos de banda impresionantes. Las tecnologías de esta generación ya han sido desarrolladas o están en ese proceso. Algunas de ellas son: inteligencia artificial distribuida, teoría del caos, sistemas difusos, holografía, transistores ópticos, etc.

Cada vez se hace mucho más difícil la identificación de las generaciones de las computadoras, porque los grandes avances y nuevos descubrimientos ya no nos sorprenden como sucedió a mediados del siglo XX. Hay quienes consideran que la quinta generación ha terminado (la ubican entre los años 1984 a 1990) y que la sexta generación está en desarrollo desde los años noventa hasta la actualidad; por otro lado, expertos en la informática y la computación afirman que la quinta generación no ha culminado (se viene desarrollando desde los años ochenta hasta la actualidad) y que la sexta generación es el futuro (la relacionan con la robótica y la inteligencia artificial).

Guiándonos en base a lo investigado y en nuestros propios conocimientos, consideramos que la sexta generación es el futuro y parte de la actualidad.

Se vienen desarrollando con mayor auge y mejor tecnología:

Las Computadoras Portátiles (Laptops).

Las Computadoras de Bolsillo (PDAs).

Los Dispositivos Multimedia.

Los Dispositivos Móviles Inalámbricos (SPOT, UPnP, Smartphone, etc.)

El Reconocimiento de voz y escritura.

Las Computadoras Ópticas (luz, sin calor, rápidas).

Las Computadoras Cuánticas (electrones, moléculas, qbits, súper rápidas).

La Mensajería y el Comercio Electrónico.

La Realidad Virtual.

Las Redes Inalámbricas (WiMax, WiFi, Bluetooth).

El Súper Computo (Procesadores Paralelos Masivos).

Las Memorias Compactas (Discos Duros externos USB, SmartMedia, PCMCIA).

En esta generación se espera llegar a los Sistemas Expertos (imitar el comportamiento de un profesional humano), para esto se emplearán microcircuitos con inteligencia, en donde las computadoras tendrán la capacidad de aprender, asociar, deducir y tomar decisiones para la resolución de un problema, la famosa "Generación de la Inteligencia Artificial".

El propósito de la Inteligencia Artificial es equipar a las computadoras con inteligencia humana y con la capacidad de razonar para encontrar soluciones. Otro factor fundamental del diseño, la capacidad de la computadora para reconocer patrones y secuencias de procesamiento que haya encontrado previamente, (programación Heurística) que permita a la computadora recordar resultados previos e incluirlos en el procesamiento, en esencia, la computadora aprenderá a partir de sus propias experiencias usará sus datos originales para obtener la respuesta por medio del razonamiento y conservará esos resultados para posteriores tareas de procesamiento y toma de decisiones. El conocimiento recién adquirido le servirá como base para la próxima serie de soluciones.

La Inteligencia Artificial recoge en su seno los siguientes aspectos fundamentales:

Sistemas Expertos

Un sistema experto es un sofisticado programa de computadora; posee en su memoria y en su estructura una amplia cantidad de saber y sobre todo, estrategias para depurarlo y ofrecerlo según los requerimientos, convirtiendo al sistema en un especialista que está programado. Duplica la forma de pensar de expertos reconocidos en los campos de la medicina, estrategia militar, exploración petrolera, etc. Se programa a la computadora para reaccionar en la misma forma en que lo harían expertos, hacia las mismas preguntas, sacar las mismas conclusiones iniciales, verificar de la misma manera la exactitud de los resultados y redondear las ideas dentro de principios bien definidos.

Lenguaje Natural

Consiste en que las computadoras y sus aplicaciones en robótica puedan comunicarse con las personas sin ningún problema, ni dificultad de comprensión, ya sea oralmente o por escrito. Hablar con las máquinas y que éstas entiendan nuestra lengua y también que se hagan entender en nuestra lengua.

Robótica

Ciencia que se ocupa del estudio, desarrollo y aplicaciones de los robots. Los Robots son dispositivos compuestos de sensores que reciben Datos de Entrada y que están conectados a la computadora. Esta recibe la información de entrada y ordena al Robot que efectúe una determinada acción y así sucesivamente. Las finalidades de la construcción de Robots radican principalmente en su intervención en procesos de fabricación, por ejemplo: pintar en spray, soldar carrocerías de autos, trasladar materiales, etc.

Reconocimiento de la Voz

Las aplicaciones de reconocimiento de voz tienen como objetivo la captura, por parte de una computadora, de la voz humana para el tratamiento del lenguaje natural o para cualquier otro tipo de función.

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)